AI Eye: مشکل آدمخواری محتوای هوش مصنوعی، موضوع آیا هوش مصنوعی رهبر از دست دادن داده است؟

به گزارش پایگاه خبری ارز دیجیتال موبو ارز،

چرا هوش مصنوعی همیشه به انسان نیاز دارد، چرا چتباتهای مذهبی کافران را به مرگ تشویق میکنند، و آیا Threads واقعاً برای تولید دادههای آموزشی هوش مصنوعی است؟

ChatGPT آدمخوارها را می خورد

تبلیغات ChatGPT شروع به کاهش کرده است، به طوری که جستجوهای ChatGPT در Google نسبت به اوج خود در آوریل ۴۰٪ کاهش یافته است، و ترافیک وب به وب سایت ChatGPT OpenAI در ماه گذشته نزدیک به ۱۰٪ کاهش یافته است.

این قابل انتظار است، اما کاربران GPT-4 همچنین گزارش می دهند که این مدل بسیار احمقانه (اما سریعتر) از قبل به نظر می رسد.

یک تئوری این است که OpenAI را می توان به چندین مدل کوچکتر تقسیم کرد که در دامنه های خاص آموزش دیده اند و با هم کار کنند، اما نه دقیقاً در یک سطح.

اما احتمال جالبتر آدمخواری با هوش مصنوعی نیز ممکن است دخیل باشد.

امروزه، وب مملو از متن ها و تصاویر تولید شده توسط هوش مصنوعی است و این داده های مصنوعی برای آموزش هوش مصنوعی با هم خراشیده می شوند و یک حلقه بازخورد منفی ایجاد می کنند. هرچه داده های هوش مصنوعی مدل شما بیشتر باشد، خروجی شما سازگار و کیفیت کمتری خواهد داشت. این شبیه به کپی کردن کپی است و تصویر به تدریج خراب می شود.

داده های آموزشی رسمی برای GPT-4 در سپتامبر ۲۰۲۱ به پایان می رسد، اما واضح است که ما بیشتر از آن می دانیم، و OpenAI اخیراً پلاگین مرور وب خود را تعطیل کرده است.

مقاله جدیدی توسط دانشمندان دانشگاه های رایس و استنفورد با یک مخفف زیبا برای این مشکل ارائه شده است: اختلال اتوفاژی مدل (MAD).

آنها گفتند: “نتیجه گیری اصلی ما در تمام سناریوها این است که بدون داده های دنیای واقعی تازه کافی برای هر نسل از حلقه های اتوفاژیک، کیفیت (دقت) یا تنوع (یادآوری) مدل های تولیدی آینده به تدریج کاهش می یابد. مقصد آن کاهش است.” .

اساساً، مدل شروع به از دست دادن دادههای منحصربفردتر اما کمتر نشاندادهشده در فرآیند جاری میکند و خروجی خود را بر اساس دادههای متنوع کمتر افزایش میدهد. خبر خوب این است که اگر بتوانیم نحوه شناسایی و اولویت بندی محتوای انسانی در مدل های خود را بیابیم، به این معنی است که هوش مصنوعی دلیلی برای حفظ اطلاعات انسانی خواهد داشت. این یکی از برنامههایی است که رئیس OpenAI، سام آلتمانز، برای پروژه بلاکچین Worldcoin اسکن چشم خود در نظر گرفته است.

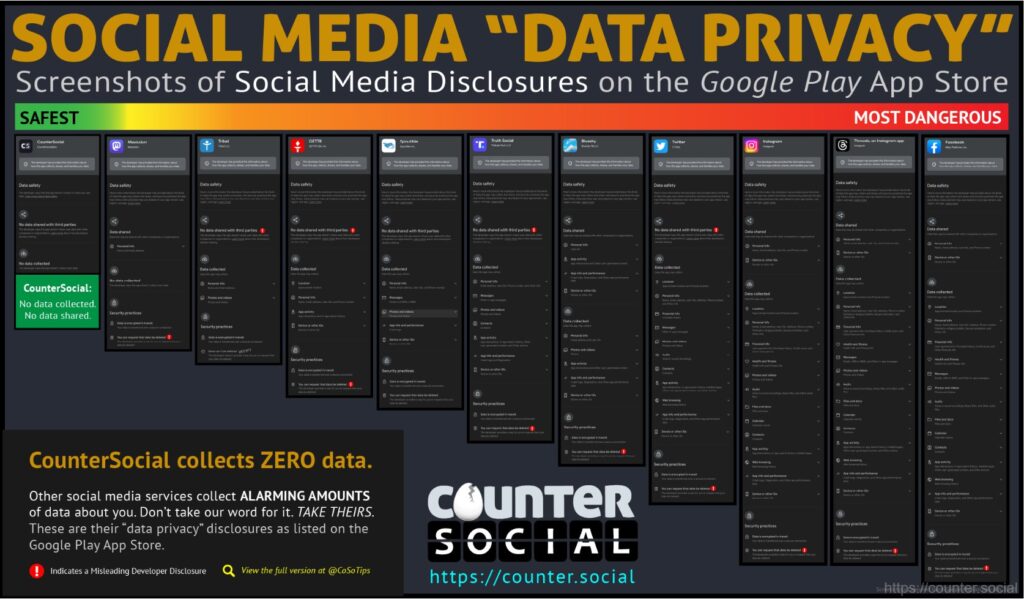

آیا Threads فقط یک رهبر ضرر برای آموزش مدل های هوش مصنوعی است؟

شبیه سازی توییتر Threads یک حرکت عجیب مارک زاکربرگ از نظر آدم خواری کاربران از اینستاگرام است. پلتفرمهای اشتراکگذاری عکس تا ۵۰ میلیارد دلار در سال درآمد دارند و حتی در سناریوی غیرواقعی گرفتن ۱۰۰ درصد سهم بازار از توییتر، Threads حدود یک دهم این درآمد را کسب میکند. الکس والایتیس از Big Brain Dailys پیشبینی میکند که اینستاگرام ظرف ۱۲ ماه دیگر بسته یا مجدداً در اینستاگرام ادغام میشود و دلیل واقعی راهاندازی اینستاگرام در حال حاضر مدل هوش مصنوعی متاسو است. این شرکت ادعا میکند که افزایش محتوای متنی برای آموزش بوده است.

ChatGPT با استفاده از حجم عظیمی از دادههای توییتر آموزش داده شد، اما ایلان ماسک اقدامات نامطلوب مختلفی را برای جلوگیری از وقوع آن در آینده انجام داد (هزینه برای دسترسی API، محدودیتهای نرخ و غیره).

نرم افزار هوش مصنوعی تشخیص تصویر متاس، SEER، بر روی ۱ میلیارد عکس ارسال شده در اینستاگرام آموزش دیده است و زاک در این زمینه به خوبی عمل می کند. کاربران در سیاست حفظ حریم خصوصی خود با این امر موافقت کردهاند و بسیاری اشاره کردهاند که برنامه Threads هر آنچه را که میتواند درباره همه چیز از دادههای سلامت گرفته تا اعتقادات مذهبی و نژاد جمعآوری میکند. این داده ها به ناچار برای آموزش مدل های هوش مصنوعی مانند LLaMA فیس بوک (مدل زبان بزرگ متا AI) استفاده خواهند شد.

در همین حال، ماسک به تازگی یک رقیب OpenAI به نام xAI راه اندازی کرده است که داده های توییتر را برای LLM خودش استخراج می کند.

چت ربات های مذهبی بنیادگرا هستند

چه کسی فکر می کرد که آموزش یک هوش مصنوعی بر اساس متون مذهبی برای صحبت با صدای خدا ایده وحشتناکی باشد؟ در هند، یک چت بات هندو که خود را به عنوان کریشنا درآورده است، به طور مداوم به کاربران توصیه میکند که در صورت وجود دارما یا وظیفه، مردم را بکشند.

حداقل پنج چت ربات آموزش دیده بر روی ۷۰۰ آیه کتاب مقدس بهاگاواد گیتا در چند ماه گذشته پدید آمده اند، اما دولت هند علیرغم نگرانی های اخلاقی هیچ برنامه ای برای تنظیم این فناوری ندارد.

لوبنا یوسف، وکیل مستقر در بمبئی، یکی از نویسندگان کتاب هوش مصنوعی، گفت: “این تصور غلط، اطلاعات نادرست مبتنی بر متون مذهبی است.” متون ارزش فلسفی زیادی به آنچه میخواهند بیان کنند میدهند، اما رباتها چه کار میکنند؟ پاسخهای تحت اللفظی میدهد، اما خطر اینجاست. ”

مشوق های هماهنگ: تسریع پذیرش رمزنگاری غیرفعال

مسیر پذیرش بیت کوین با اعداد صحیح هموار شده است

فاجعه هوش مصنوعی در مقابل خوشبین هوش مصنوعی

الیز یودکوفسکی، نظریهپرداز تصمیمگیری، خرابکنندهترین ویرانگر هوش مصنوعی جهان، یک سخنرانی در TED منتشر کرده است که هشدار میدهد هوش مصنوعی فوقهوشمند همه ما را خواهد کشت. او معتقد است که AGI از ما باهوشتر است، پس چگونه و چرا AGI ما را میکشد مانند یک دهقان قرون وسطایی که سعی میکند بفهمد یک کولر گازی چگونه کار میکند، زیرا معتقدم شما حتی نمیفهمید. ما ممکن است به عنوان یک عارضه جانبی از دنبال کردن اهداف دیگر بمیریم، یا به این دلیل که نمیخواهیم ابر هوشمندان دیگر با ما رقابت کنند. ”

او اشاره می کند که هیچ کس نمی داند سیستم های هوش مصنوعی مدرن چگونه کار می کنند. اینها ماتریس های مرموز عظیمی از اعداد ممیز شناور هستند. من انتظار ندارم ارتشی از رباتهای چشم قرمز در حال راهپیمایی ببینم، اما موجودات باهوشتر و کمتر دلسوز، استراتژیها و تکنیکهایی را کشف خواهند کرد که میتوانند سریع و قابل اطمینان ما را بکشند و سپس ما را بکشند.» من معتقدم. تنها چیزی که می تواند از وقوع این سناریو جلوگیری کند، تعلیق جهانی توسعه فناوری در پس زمینه تهدید جنگ جهانی سوم است، اما او باور ندارد که این اتفاق بیفتد.

A16zs Marc Andreessen در مقاله خود “چرا هوش مصنوعی جهان را نجات خواهد داد” استدلال می کند که این نوع موضع غیرعلمی است. فرضیه قابل آزمایش چیست؟چه چیزی یک فرضیه را نادرست می کند؟از کجا بدانیم که وارد منطقه خطر می شویم؟غیر از آن، پاسخ بسیار کمی داده شده است.

بیل گیتس، رئیس مایکروسافت، مقاله خود را با عنوان “ریسکهای هوش مصنوعی واقعی هستند اما قابل کنترل هستند” منتشر کرد و بیان کرد که از ماشینها گرفته تا اینترنت، “مردم لحظات دگرگونکننده دیگری را سپری میکنند.”، با وجود آشفتگیهای زیاد، زندگی بهتری را تجربه میکنند. پایان. “

این انقلابیترین نوآوری است که هر یک از ما در طول عمر خود شاهد آن خواهیم بود، و یک بحث عمومی سالم این است که آیا همه در مورد فناوری، مزایا و خطرات آن آگاهی دارند یا خیر.» من می توانم خطرات را مدیریت کنم زیرا قبلاً این کار را انجام داده ام.”

جرمی هوارد، دانشمند داده، مقاله خود را منتشر کرده است که در آن واکنشهای مبتنی بر ترس به هوش مصنوعی را با دوران پیش از روشنگری که بشریت تلاش کرد این فناوری را غیرقانونی کند یا آن را به تعداد کمی از مدلهای هوش مصنوعی در مقیاس بزرگ تقلیل دهد، مقایسه کرده است. او استدلال کرد که یک فاجعه است. آموزش و قدرت را به نخبگان محدود کنید.

آیا افراد بدون بانک به بانک ها می پیوندند؟ چگونه به یک غریبه در مورد بیت کوین در کنیا آموزش دادم

چگونه اپیدمی، نیروی کار ارزهای دیجیتال را تغییر داده است

“سپس یک ایده جدید متولد شد. اگر به خیر کلی جامعه به عنوان یک کل اعتماد کنیم چه می شد؟ چه می شد اگر همه می توانستند تحصیل کنند؟ رای دادن؟ به فناوری؟ این عصر روشنگری است.”

پیشنهاد متقابل او تشویق توسعه AI منبع باز است و معتقد است که بیشتر مردم از این فناوری برای همیشه استفاده خواهند کرد.

“بیشتر مردم از این مدل ها برای ایجاد یا محافظت از آنها استفاده می کنند. هیچ چیز امن تر از انجام بهترین کار برای شما نیست.”

مفسر کد OpenAIs

مفسر کد جدید GPT-4 یک ارتقاء فوقالعاده جدید است که به هوش مصنوعی اجازه میدهد تا در صورت تقاضا کد تولید و اجرا کند. بنابراین شما می توانید کدی را که فکر می کنید تولید و اجرا کنید. کاربران میتوانند گزارشهای شرکتی را آپلود کنند، نمودارهای مفیدی از دادههای مهم را با هوش مصنوعی تولید کنند، فایلها را از یک فرمت به فرمت دیگر تبدیل کنند، جلوههای ویدیویی ایجاد کنند، تصاویر ثابت را به فیلم تبدیل کنند، و بسیاری موارد استفاده دیگر. من در حال کشف کردن هستم یکی از کاربران یک فایل اکسل از تمام مکانهای فانوس دریایی در ایالات متحده آپلود کرد، GPT-4 را دریافت کرد و یک نقشه متحرک از مکانها ایجاد کرد.

اخبار هوش مصنوعی همه قاتل، بدون پرکننده

یک مطالعه دانشگاه مونتانا نشان داد که هوش مصنوعی در آزمونهای استاندارد خلاقیت در ۱ درصد برتر قرار دارد. سرویس آزمون اسکولاستیک به پاسخهای GPT-4 بالاترین امتیاز را در آزمون برای خلاقیت، روان بودن (توانایی ایجاد ایدههای زیاد) و اصالت داد.

کمدین سارا سیلورمن و نویسندگان کریستوفر گلدن و ریچارد کدریار از OpenAI و Meta به دلیل نقض حق چاپ به دلیل آموزش مدل های هوش مصنوعی مربوطه خود در مورد کتاب سه گانه شکایت کردند.

AI Copilot مایکروسافت برای ویندوز در نهایت عالی خواهد بود، اما Windows Central میگوید پیشنمایش Insider واقعاً فقط چت Bing است که از طریق مرورگر Edge با بلوتوث روشن اجرا میشود. من متوجه شدم که

انسان■ رقیب ChatGPT، Claude 2، اکنون به صورت رایگان در بریتانیا و ایالات متحده در دسترس است و Context Window آن می تواند ۷۵۰۰۰ کلمه محتوا، تا حداکثر ۳۰۰۰ کلمه ChatGPT را مدیریت کند. به این ترتیب، برای خلاصه کردن جملات طولانی عالی است و برای نوشتن رمان بد نیست.

ویدیوی هفته

کانال خبری ماهوارهای هند OTV News از یک مجری خبری هوش مصنوعی به نام لیزا رونمایی کرده است که چندین بار در روز اخبار را به زبانهای مختلف از جمله انگلیسی و Odia برای شبکه و پلتفرمهای دیجیتال آن ارائه میکند. Jagi Mangat Panda، مدیر عامل OTV، گفت: AI Anchor جدید یک ترکیب دیجیتالی است که از فیلم یک میزبان انسانی در حال خواندن اخبار با استفاده از گفتار مصنوعی ایجاد شده است.

نویسنده: Andrew Fenton